Stackable Data Platform (SDP) 란?

Stackable은 쿠버네티스 환경에서 데이터 관련 애플리케이션들을 손쉽게 배포 관리해 주는 오퍼레이터입니다.

https://docs.stackable.tech/home/stable/

Stackable Documentation :: Stackable Documentation

Welcome to Stackable! This documentation gives you an overview of the Stackable Data Platform, how to install and manage it as well as some tutorials. Introduction The Stackable Data Platform allows you to deploy, scale and manage Data infrastructure in an

docs.stackable.tech

아래와 같은 다양한 컴포넌트들을 지원함으로써, 데이터 관련 전문적인 지식이 없어도 배포 및 관리할 수 있습니다.

Stackable 설치

- stackablectl 명령어를 통해 설치를 지원합니다.

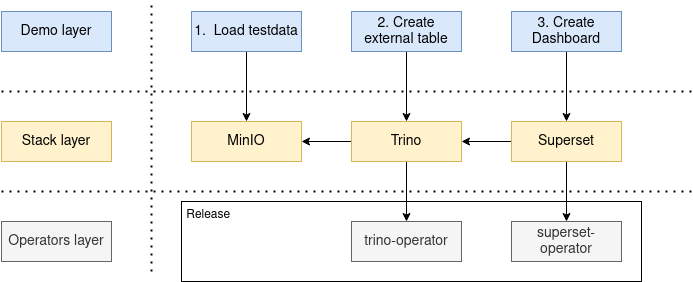

- ( Operator > Stack > Demo ) Layer로 구성됩니다.

- Demo Layer를 통해 데이터 플랫폼의 데모 환경을 손쉽게 만들 수 있습니다.

# 다운로드

#curl -L -o stackablectl https://github.com/stackabletech/stackable-cockpit/releases/download/stackablectl-1.0.0-rc2/stackablectl-x86_64-unknown-linux-gnu

curl -L -o stackablectl https://github.com/stackabletech/stackable-cockpit/releases/download/stackablectl-1.0.0-rc3/stackablectl-x86_64-unknown-linux-gnu

chmod +x stackablectl

mv stackablectl /usr/local/bin

# 확인

stackablectl -h

stackablectl -V

stackablectl 1.0.0-rc3

stackablectl release list

...

# 자동완성

wget https://raw.githubusercontent.com/stackabletech/stackable-cockpit/main/extra/completions/stackablectl.bash

mv stackablectl.bash /etc/bash_completion.d/

# 제공 오퍼레이터

stackablectl operator list

┌────┬───────────┬─────────────────────────────────────────────────────────────────────────────────────────────────┐

│ # ┆ OPERATOR ┆ STABLE VERSIONS │

╞════╪═══════════╪═════════════════════════════════════════════════════════════════════════════════════════════════╡

│ 1 ┆ airflow ┆ 0.1.0, 0.2.0, 0.3.0, 0.4.0, 0.5.0, 0.6.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 2 ┆ commons ┆ 0.1.0, 0.2.0, 0.2.1, 0.3.0, 0.4.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 3 ┆ druid ┆ 0.1.0, 0.2.0, 0.3.0, 0.4.0, 0.5.0, 0.6.0, 0.7.0, 0.8.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 4 ┆ hbase ┆ 0.2.0, 0.3.0, 0.4.0, 0.5.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 5 ┆ hdfs ┆ 0.3.0, 0.4.0, 0.5.0, 0.6.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 6 ┆ hive ┆ 0.3.0, 0.5.0, 0.6.0, 0.7.0, 0.8.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 7 ┆ kafka ┆ 0.4.0, 0.5.0, 0.6.0, 0.7.0, 0.8.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 8 ┆ listener ┆ 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 9 ┆ nifi ┆ 0.4.0, 0.5.0, 0.6.0, 0.7.0, 0.8.0, 0.8.1, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 10 ┆ opa ┆ 0.10.0, 0.11.0, 0.6.0, 0.7.0, 0.8.0, 0.9.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 11 ┆ secret ┆ 0.1.0, 0.2.0, 0.3.0, 0.4.0, 0.5.0, 0.6.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 12 ┆ spark-k8s ┆ 0.1.0, 0.2.0, 0.3.0, 0.4.0, 0.5.0, 0.6.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 13 ┆ superset ┆ 0.1.0, 0.2.0, 0.3.0, 0.4.0, 0.5.0, 0.6.0, 0.7.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 14 ┆ trino ┆ 0.2.0, 0.3.0, 0.3.1, 0.4.0, 0.5.0, 0.6.0, 0.7.0, 0.8.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

├╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ 15 ┆ zookeeper ┆ 0.10.0, 0.11.0, 0.12.0, 0.6.0, 0.7.0, 0.8.0, 0.9.0, 23.1.0, 23.11.0, 23.4.0, 23.4.1, 23.7.0 │

└────┴───────────┴─────────────────────────────────────────────────────────────────────────────────────────────────┘

# 제공 스택

stackablectl stack list

# 제공 데모 : Stackable release 설치 > 스택 구성 > 데이터 구성

stackablectl demo list

Demo: Trino-Taxi-Data

Demo 정보 확인

# Demo 정보 확인

stackablectl demo list

stackablectl demo list -o json | jq

stackablectl demo describe trino-taxi-data

Demo trino-taxi-data

Description Demo loading 2.5 years of New York taxi data into S3 bucket, creating a Trino table and a Superset dashboard

Documentation https://docs.stackable.tech/stackablectl/stable/demos/trino-taxi-data.html

Stackable stack trino-superset-s3

Labels trino, superset, minio, s3, ny-taxi-dataDemo 구성

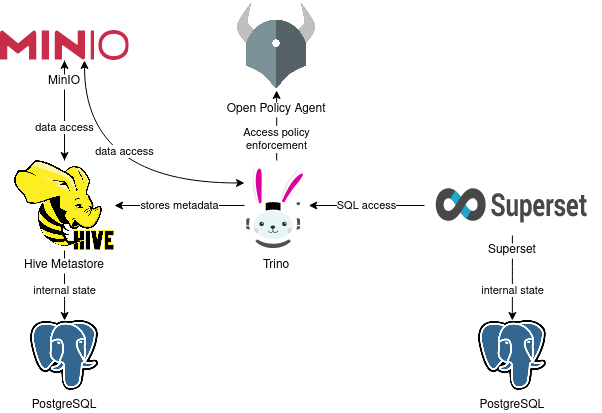

- MinIO: 오픈 소스 분산 오브젝트 스토리지 서버로, S3 호환 API를 지원하여 개발자가 간편하게 대규모 데이터를 저장하고 검색할 수 있게 해 줍니다.

- Hive Maestore: Apache Hive의 중심 데이터 딕셔너리 서비스로, Hive에서 생성된 테이블 및 파티션 메타데이터를 관리하는 역할을 합니다.

- PostgreSQL: 오픈 소스 관계형 데이터베이스 관리 시스템(RDBMS)으로, 확장 가능하고 ACID(원자성, 일관성, 고립성, 지속성) 속성을 갖춘 데이터베이스 서버입니다.

- OpenPolicyAgent(OPA): 정책을 관리하고 시스템에서 접근 제어, 검증, 정책 쿼리를 수행하기 위한 오픈 소스 정책 엔진입니다.

- Trino: 분산 데이터 처리를 위한 오픈 소스 쿼리 엔진입니다

- Superset: 오픈 소스 비즈니스 인텔리전스 플랫폼으로, 데이터 시각화와 대시보드 작성을 위한 도구입니다

설치

# [터미널] 모니터링

watch -d "kubectl get pod -n stackable-operators;echo;kubectl get pod,job,svc,pvc"

# 데모 설치 : 데이터셋 다운로드 job 포함 8분 정도 소요

stackablectl demo install trino-taxi-data

# 설치 확인

helm list -n stackable-operators

helm list

kubectl top node

kubectl top pod -A

kubectl get-all -n default

kubectl get deploy,sts,pod

kubectl get job

kubectl get job load-ny-taxi-data -o yaml | kubectl neat | cat -l yaml

kubectl get job create-ny-taxi-data-table-in-trino -o yaml | kubectl neat | cat -l yaml

kubectl get job setup-superset -o yaml | kubectl neat | cat -l yaml

kubectl get job superset -o yaml | kubectl neat | cat -l yaml

kubectl get sc,pvc,pv

kubectl get pv |grep gp3

kubectl get sc secrets.stackable.tech -o yaml | kubectl neat | cat -l yaml

kubectl df-pv

kubectl get svc,ep,endpointslices

kubectl get cm,secret

kubectl get cm minio -o yaml | kubectl neat | cat -l yaml

kubectl describe cm minio

kubectl get cm hive-metastore-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm hive -o yaml | kubectl neat | cat -l yaml

kubectl get cm postgresql-hive-extended-configuration -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-coordinator-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-coordinator-default-catalog -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-worker-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-worker-default-catalog -o yaml | kubectl neat | cat -l yaml

kubectl get cm create-ny-taxi-data-table-in-trino-script -o yaml | kubectl neat | cat -l yaml

kubectl get cm superset-node-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm superset-init-db -o yaml | kubectl neat | cat -l yaml

kubectl get cm setup-superset-script -o yaml | kubectl neat | cat -l yaml

kubectl get secret minio -o yaml | kubectl neat | cat -l yaml

kubectl get secret minio-s3-credentials -o yaml | kubectl neat | cat -l yaml

kubectl get secret postgresql-hive -o yaml | kubectl neat | cat -l yaml

kubectl get secret postgresql-superset -o yaml | kubectl neat | cat -l yaml

kubectl get secret trino-users -o yaml | kubectl neat | cat -l yaml

kubectl get secret trino-internal-secret -o yaml | kubectl neat | cat -l yaml

kubectl get secret superset-credentials -o yaml | kubectl neat | cat -l yaml

kubectl get secret superset-mapbox-api-key -o yaml | kubectl neat | cat -l yaml

kubectl get crd | grep stackable

kubectl explain trinoclusters

kubectl describe trinoclusters.trino.stackable.tech

kubectl get hivecluster,opacluster,s3connection

kubectl get supersetcluster,supersetdb

kubectl get trinocluster,trinocatalog

kubectl get hivecluster -o yaml | kubectl neat | cat -l yaml

kubectl get s3connection -o yaml | kubectl neat | cat -l yaml

kubectl get supersetcluster -o yaml | kubectl neat | cat -l yaml

kubectl get supersetdb -o yaml | kubectl neat | cat -l yaml

kubectl get trinocluster -o yaml | kubectl neat | cat -l yaml

kubectl get trinocatalog -o yaml | kubectl neat | cat -l yaml

# 배포 스택 정보 확인 : 바로 확인 하지 말고, 설치 완료 후 아래 확인 할 것 - Endpoint(접속 주소 정보), Conditions(상태 정보)

stackablectl stacklet list

┌────────────┬──────────────────────────────────┬────────────┬──────────────────────────────────────────────────┬─────────────────────────────────┐

│ PRODUCT ┆ NAME ┆ NAMESPACE ┆ ENDPOINTS ┆ CONDITIONS │

╞════════════╪══════════════════════════════════╪════════════╪══════════════════════════════════════════════════╪═════════════════════════════════╡

│ hive ┆ hive ┆ default ┆ ┆ Available, Reconciling, Running │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ opa ┆ opa ┆ default ┆ ┆ Available, Reconciling, Running │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ superset ┆ superset ┆ default ┆ external-superset http://43.202.112.25:31493 ┆ Available, Reconciling, Running │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ trino ┆ trino ┆ default ┆ coordinator-metrics 15.164.129.120:30531 ┆ Available, Reconciling, Running │

│ ┆ ┆ ┆ coordinator-https https://15.164.129.120:31597 ┆ │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ grafana ┆ kube-prometheus-stack-grafana ┆ monitoring ┆ ┆ │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ minio ┆ minio-console ┆ default ┆ http http://3.35.25.225:30697 ┆ │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ prometheus ┆ kube-prometheus-stack-prometheus ┆ monitoring ┆ ┆ │

└────────────┴──────────────────────────────────┴────────────┴──────────────────────────────────────────────────┴─────────────────────────────────┘

# 배포 스택의 product 접속 계정 정보 확인 : 대부분 admin / adminadmin 계정 정보 사용

stackablectl stacklet credentials superset superset

stackablectl stacklet credentials minio minio-console # admin / adminadmin 계정 정보 출력 안됨... 아직은 rc 단계라 그런듯

# 배포 오퍼레이터 확인

stackablectl operator installed

┌───────────────────┬─────────┬─────────────────────┬──────────┬─────────────────────────────────────────┐

│ OPERATOR ┆ VERSION ┆ NAMESPACE ┆ STATUS ┆ LAST UPDATED │

╞═══════════════════╪═════════╪═════════════════════╪══════════╪═════════════════════════════════════════╡

│ commons-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:37:56.08217875 +0900 KST │

├╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ hive-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:38:13.358512684 +0900 KST │

├╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ opa-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:38:32.724016087 +0900 KST │

├╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ secret-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:38:51.410402351 +0900 KST │

├╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ superset-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:38:56.963602496 +0900 KST │

├╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ trino-operator ┆ 23.7.0 ┆ stackable-operators ┆ deployed ┆ 2023-11-19 10:39:15.346593878 +0900 KST │

└───────────────────┴─────────┴─────────────────────┴──────────┴─────────────────────────────────────────┘

S3 Demo data(Minio) 확인

- minio console에 접속하여 demo taxi data를 확인합니다.

- ENDPOINT 확인: stackablectl stacklet list | grep minio

- 초기 계정정보: admin / adminadmin

- 2020 ~ 2021년까지의 택시 데이터를 볼 수 있으며, 특히, 코로나 기간에는 데이터의 사이즈가 급격하게 감소하는 것을 보입니다.

- parquet 확장자 : 대량의 데이터를 저장하고 분석하기 위한 열 지향 형식의 오픈 소스 데이터 파일 포맷을 나타냅니다.

쿠버네티스 job을 통해 아래와 같이 2020~2021까지의 택시 데이터를 다운로드하고, Minio로 업로드하는 과정을 자동화합니다.

# 데이터셋 다운로드 동작 확인

kubectl get job load-ny-taxi-data -o yaml | kubectl neat | cat -l yaml -p

...

spec:

containers:

- command:

- bash

- -c

- cd /tmp && for month in 2020-01 2020-02 2020-03 2020-04 2020-05 2020-06

2020-07 2020-08 2020-09 2020-10 2020-11 2020-12 2021-01 2021-02 2021-03

2021-04 2021-05 2021-06 2021-07 2021-08 2021-09 2021-10 2021-11 2021-12

2022-01 2022-02 2022-03 2022-04; do curl -O https://repo.stackable.tech/repository/misc/ny-taxi-data/yellow_tripdata_$month.parquet

&& mc --insecure alias set minio http://minio:9000/ $(cat /minio-s3-credentials/accessKey)

$(cat /minio-s3-credentials/secretKey) && mc cp yellow_tripdata_$month.parquet minio/demo/ny-taxi-data/raw/; done

...

Trino Web Console 확인

- Trino Web console에 접속합니다.

- ENDPOINT 확인: stackablectl stacklet list | grep trino

- 초기 계정정보: admin / adminadmin

Trino 정보 확인

#

kubectl get svc,ep trino-coordinator

#

kubectl get job create-ny-taxi-data-table-in-trino -o yaml | kubectl neat | cat -l yaml

kubectl get trinocluster,trinocatalog

kubectl get trinocluster -o yaml | kubectl neat | cat -l yaml -p

kubectl get trinocatalog -o yaml | kubectl neat | cat -l yaml -p

...

spec:

connector: # hive, s3

hive:

metastore:

configMap: hive

s3:

reference: minio

...

#

kubectl get cm trino-coordinator-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-coordinator-default-catalog -o yaml | kubectl neat | cat -l yaml -p

...

data:

hive.properties: |

connector.name=hive

hive.metastore.uri=thrift\://hive-metastore-default-0.hive-metastore-default.default.svc.cluster.local\:9083

hive.s3.aws-access-key=${ENV\:CATALOG_HIVE_HIVE_S3_AWS_ACCESS_KEY}

hive.s3.aws-secret-key=${ENV\:CATALOG_HIVE_HIVE_S3_AWS_SECRET_KEY}

hive.s3.endpoint=http\://minio\:9000

hive.s3.path-style-access=true

hive.s3.ssl.enabled=false

hive.security=allow-all

...

kubectl get cm trino-worker-default -o yaml | kubectl neat | cat -l yaml

kubectl get cm trino-worker-default-catalog -o yaml | kubectl neat | cat -l yaml

kubectl get cm create-ny-taxi-data-table-in-trino-script -o yaml | kubectl neat | cat -l yaml

#

kubectl get secret trino-users -o yaml | kubectl neat | cat -l yaml

kubectl get secret trino-internal-secret -o yaml | kubectl neat | cat -l yaml

trino-operator를 통해서 trino worker 2대로 증설

# 오퍼레이터 로깅 수준을 높여보자..

kubectl logs -n stackable-operators -l app.kubernetes.io/instance=trino-operator -f

# trino worker 2대로 증설

kubectl get trinocluster trino -o json | cat -l json -p

kubectl patch trinocluster trino --type='json' -p='[{"op": "replace", "path": "/spec/workers/roleGroups/default/replicas", "value":2}]'

Superset Web Console 확인

- Trino Web console에 접속합니다.

- ENDPOINT 확인: stackablectl stacklet list | grep trino

- 초기 계정정보: admin / adminadmin

- SQL 쿼리 실행 및 대시보드 가능합니다.

- Dashboards" 탭에서 "Taxi data" 대시보드를 확인하고 연결된 Trino와 같이 확인합니다.

Demo 삭제

- 아쉽게도 stackablectl 명령어로 Demo Layer는 쉽게 설치할 수 있지만 삭제 시에는 수동으로 리소스들을 찾아 삭제해주어야 합니다.

- get-all(krew plugin)을 활용해 남은 리소스 확인합니다.

- stackable operator는 stackablectl 명령어를 통해 삭제를 지원한다.

#

kubectl delete supersetcluster,supersetdb superset

kubectl delete trinocluster trino && kubectl delete trinocatalog hive

kubectl delete hivecluster hive

kubectl delete s3connection minio

kubectl delete opacluster opa

#

helm uninstall postgresql-superset

helm uninstall postgresql-hive

helm uninstall minio

#

kubectl delete job --all

kubectl delete pvc --all

#

kubectl delete cm create-ny-taxi-data-table-in-trino-script setup-superset-script trino-opa-bundle

kubectl delete secret minio-s3-credentials secret-provisioner-tls-ca superset-credentials superset-mapbox-api-key trino-users

kubectl delete sa superset-sa

# operator 삭제

stackablectl operator uninstall superset trino hive secret opa commons

# 남은 리소스 확인

kubectl get-all -n stackable-operators

Stackable Operator

- Stackable Operator를 통해 지원하는 릴리즈를 손쉽게 배포합니다.

- zookeeper, kafka, nifi

Operator 설치

# [터미널1] 모니터링

watch -d "kubectl get pod -n stackable-operators"

# [터미널2] 설치

stackablectl release list

stackablectl release install -i commons -i secret -i zookeeper -i kafka -i nifi 23.7

[INFO ] Installing release 23.7

[INFO ] Installing commons operator in version 23.7.0

[INFO ] Installing kafka operator in version 23.7.0

[INFO ] Installing nifi operator in version 23.7.0

[INFO ] Installing secret operator in version 23.7.0

[INFO ] Installing zookeeper operator in version 23.7.0

# 설치 확인

helm list -n stackable-operators

stackablectl operator installed

kubectl get crd | grep stackable.tech

kubectl get pod

Apache ZooKeeper 클러스터

Apache ZooKeeper는 분산 시스템의 구성 관리 및 조정(coordination)을 담당하는 오픈 소스 프레임워크입니다.

설치

kubectl apply -f - <<EOF

---

apiVersion: zookeeper.stackable.tech/v1alpha1

kind: ZookeeperCluster

metadata:

name: simple-zk

spec:

image:

productVersion: "3.8.1"

stackableVersion: "23.7"

clusterConfig:

tls:

serverSecretClass: null

servers:

roleGroups:

primary:

replicas: 1

config:

myidOffset: 10

---

apiVersion: zookeeper.stackable.tech/v1alpha1

kind: ZookeeperZnode

metadata:

name: simple-zk-znode

spec:

clusterRef:

name: simple-zk

EOF설치 확인

# 설치 확인

kubectl get zookeepercluster,zookeeperznode

kubectl get pod,svc,ep,pvc -l app.kubernetes.io/instance=simple-zk

kubectl describe pod -l app.kubernetes.io/instance=simple-zk

# 실시간 로그 확인

kubectl logs -l app.kubernetes.io/instance=simple-zk -c zookeeper -f

Apache Kafka Cluster

안정적이고 확장 가능한 데이터 통신을 지원하는 대규모의 실시간 데이터 스트리밍 및 메시지 큐 시스템

설치

kubectl apply -f - <<EOF

---

apiVersion: kafka.stackable.tech/v1alpha1

kind: KafkaCluster

metadata:

name: simple-kafka

spec:

image:

productVersion: "3.4.0"

stackableVersion: "23.7"

clusterConfig:

zookeeperConfigMapName: simple-kafka-znode

tls:

serverSecretClass: null

brokers:

roleGroups:

brokers:

replicas: 3

---

apiVersion: zookeeper.stackable.tech/v1alpha1

kind: ZookeeperZnode

metadata:

name: simple-kafka-znode

spec:

clusterRef:

name: simple-zk

namespace: default

EOF설치 확인

# 설치 확인

kubectl get kafkacluster,zookeeperznode

kubectl get pod,svc,ep,pvc -l app.kubernetes.io/instance=simple-kafka

kubectl describe pod -l app.kubernetes.io/instance=simple-kafka

# 실시간 로그 확인

kubectl logs -l app.kubernetes.io/instance=simple-kafka -c kafka -f

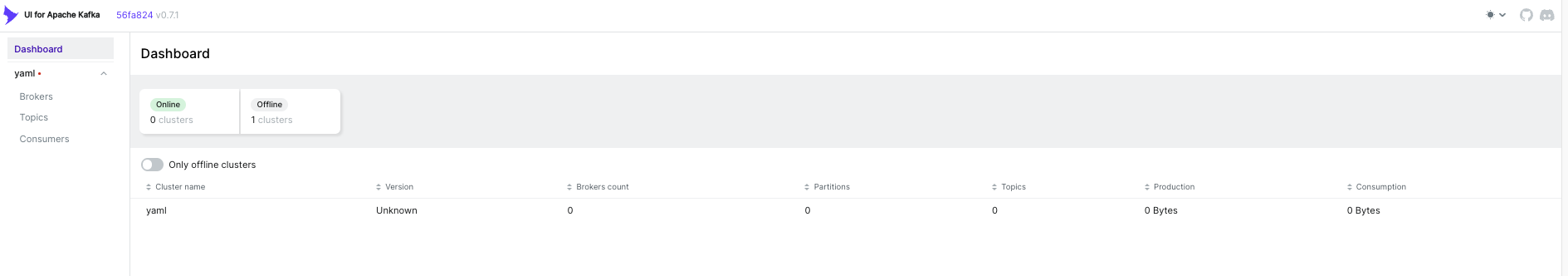

kafka UI

설치

#

helm repo add kafka-ui https://provectus.github.io/kafka-ui-charts

cat <<EOF > kafkaui-values.yml

yamlApplicationConfig:

kafka:

clusters:

- name: yaml

bootstrapServers: simple-kafka-broker-brokers:9092

auth:

type: disabled

management:

health:

ldap:

enabled: false

EOF

# 설치

helm install kafka-ui kafka-ui/kafka-ui -f kafkaui-values.yml

# 접속 확인

kubectl patch svc kafka-ui -p '{"spec":{"type":"LoadBalancer"}}'

kubectl annotate service kafka-ui "external-dns.alpha.kubernetes.io/hostname=kafka-ui.$MyDomain"

echo -e "kafka-ui Web URL = http://kafka-ui.$MyDomain"

설치 확인

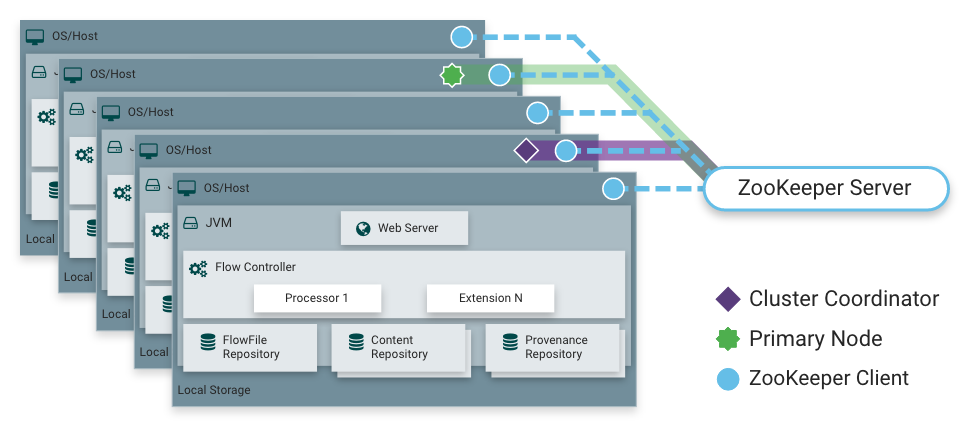

Apache NiFI

데이터 플로우를 자동화하고 관리하기 위한 오픈 소스 데이터 통합 도구로, 다양한 소스 및 대상 간에 데이터 이동 및 변환을 용이하게 처리합니다.

https://nifi.apache.org/docs.html

Apache NiFi Documentation

Copyright © 2023 The Apache Software Foundation, Licensed under the Apache License, Version 2.0. Apache, the Apache feather logo, NiFi, Apache NiFi and the project logo are trademarks of The Apache Software Foundation.

nifi.apache.org

설치

kubectl apply -f - <<EOF

---

apiVersion: zookeeper.stackable.tech/v1alpha1

kind: ZookeeperZnode

metadata:

name: simple-nifi-znode

spec:

clusterRef:

name: simple-zk

---

apiVersion: v1

kind: Secret

metadata:

name: nifi-admin-credentials-simple

stringData:

username: admin

password: AdminPassword

---

apiVersion: nifi.stackable.tech/v1alpha1

kind: NifiCluster

metadata:

name: simple-nifi

spec:

image:

productVersion: "1.21.0"

stackableVersion: "23.7"

clusterConfig:

listenerClass: external-unstable

zookeeperConfigMapName: simple-nifi-znode

authentication:

method:

singleUser:

adminCredentialsSecret: nifi-admin-credentials-simple

sensitiveProperties:

keySecret: nifi-sensitive-property-key

autoGenerate: true

nodes:

roleGroups:

default:

replicas: 1

EOF설치확인

# 설치 확인 : job 완료까지 다소 시간 소요됨

kubectl get nificluster,zookeeperznode

kubectl get pod,svc,ep,pvc,job -l app.kubernetes.io/instance=simple-nifi

kubectl describe job.batch/simple-nifi-create-reporting-task-1-21-0

kubectl describe pod -l app.kubernetes.io/instance=simple-nifi

...

Args:

/stackable/python/create_nifi_reporting_task.py -n https://simple-nifi.default.svc.cluster.local:8443/nifi-api -u "$(cat /stackable/adminuser/username | grep -oP '((cn|dn|uid)=\K[^,]+|.*)' | head -n 1)" -p "$(cat /stackable/adminuser/password)" -v 1.21.0 -m 8081 -c /stackable/cert/ca.crt

...

# 실시간 로그 확인

kubectl logs -l app.kubernetes.io/instance=simple-nifi -c nifi -f

Operator Relase 삭제

실습이 끝난 후, 설치한 릴리즈들을 모두 삭제합니다.

# 설치한 릴리즈 확인

stackablectl stacklet list

┌────────────┬──────────────────────────────────┬────────────┬─────────────────────────────────────┬─────────────────────────────────┐

│ PRODUCT ┆ NAME ┆ NAMESPACE ┆ ENDPOINTS ┆ CONDITIONS │

╞════════════╪══════════════════════════════════╪════════════╪═════════════════════════════════════╪═════════════════════════════════╡

│ kafka ┆ simple-kafka ┆ default ┆ metrics 3.35.25.225:32611 ┆ Available, Reconciling, Running │

│ ┆ ┆ ┆ kafka 3.35.25.225:32283 ┆ │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ nifi ┆ simple-nifi ┆ default ┆ https https://43.202.112.25:32669 ┆ Available, Reconciling, Running │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ zookeeper ┆ simple-zk ┆ default ┆ ┆ Available, Reconciling, Running │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ grafana ┆ kube-prometheus-stack-grafana ┆ monitoring ┆ ┆ │

├╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┼╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌╌┤

│ prometheus ┆ kube-prometheus-stack-prometheus ┆ monitoring ┆ ┆ │

└────────────┴──────────────────────────────────┴────────────┴─────────────────────────────────────┴─────────────────────────────────┘

# Apache NiFi 삭제

kubectl delete nificluster simple-nifi && kubectl delete zookeeperznode simple-nifi-znode

# kafka-ui 삭제

helm uninstall kafka-ui

# Apache kafka 삭제

kubectl delete kafkacluster simple-kafka && kubectl delete zookeeperznode simple-kafka-znode

# Apache ZooKeeper 삭제

kubectl delete zookeepercluster simple-zk && kubectl delete zookeeperznode simple-zk-znode

# secret, pvc 삭제

kubectl delete secret nifi-admin-credentials-simple nifi-sensitive-property-key secret-provisioner-tls-ca

kubectl delete pvc --all

# operator 삭제

stackablectl operator uninstall nifi kafka zookeeper secret commons

# 남은 리소스 확인

kubectl get-all -n stackable-operators'Kubernetes > Database Operator' 카테고리의 다른 글

| 쿠버네티스 데이터베이스 오퍼레이터 스터디 2기(DOIK2) 마치며 (2) | 2023.11.28 |

|---|---|

| Kafka Operator(Strimzi) - DOIK2_5주차 (0) | 2023.11.19 |

| MongoDB Operator - Percona Operator for MongoDB(PSMDB) - DOIK 4주차 (4) | 2023.11.12 |

| PostgreSQL Operator - CloudNative PostgreSQL - DOIK2_3주차 (1) | 2023.11.05 |

| 쿠버네티스 MySQL InnoDB Cluster - DOIK2_2주차 2 (2) | 2023.10.28 |